“AI, 잘못 사용땐 인간성 파괴 위험… 비판적 사고-교육 필요”

- 동아일보

공유하기

글자크기 설정

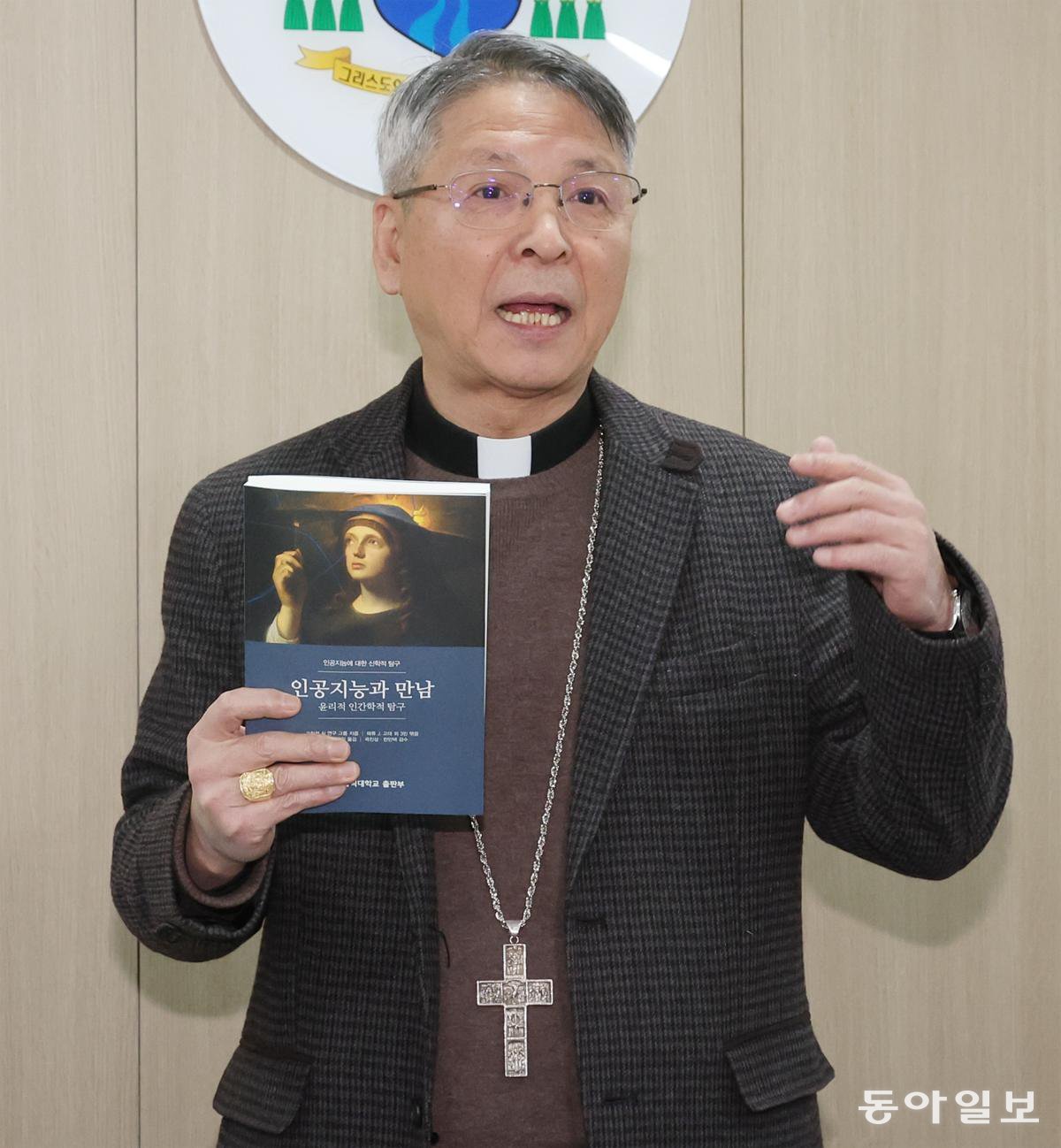

‘인공지능과…’ 번역총괄 이성효 주교

교황청, 2020년 ‘AI 연구그룹’ 결성… 존엄성 존중-조작 방지 등 기준 제안

스위스선 고해성사에 AI 도입 실험… 통제장치 없다면 부작용 클 수 있어

지난해 8월 스위스 루체른의 한 성당에서 인공지능(AI)이 신자들의 고해성사를 들어주는 실험을 했다. 고해성사는 신부에게 자신의 죄를 고백하고 용서받는 의식. 가톨릭에서 성스럽게 여기는 성사(聖事)에 AI가 도입된 것이다. 실험은 두 달 정도 관광객과 신자들을 대상으로 진행되다 중단됐다. 워낙 파격적이라 사전에 교황청 허락까지 받았지만, 신자들의 반발이 거셌기 때문이다.

최근 교황청의 ‘인공지능과 만남: 윤리적 인간학적 탐구’ 한국어판 번역·출간을 총괄한 이성효 주교(교황청 문화교육부 위원·천주교 마산교구장)는 지난달 31일 경기 수원시 천주교 수원교구 제1대리구청에서 가진 인터뷰에서 “AI는 인간의 삶을 혁신하고 편리하게 하지만, 잘못 사용하면 윤리적 문제는 물론이고 인간성을 파괴할 위험이 있다”라며 “AI 사용에 대한 비판적 사고와 교육이 필요한 때”라고 말했다. 교황청은 AI 시대에 대비해 2020년 문화교육부 안에 매튜 J 고데, 노린 헤르츠펠트 등 20여 명의 세계적 신학자, 철학자, 윤리학자로 구성된 ‘AI 연구 그룹’을 결성하고 지난해 12월 이 책을 발간했다. 영어판 외에는 지난달 초 한국어판이 가장 먼저 나왔다.

이 주교는 “AI라는 엄청난 문화적 변화도 우리가 온전한 인간다움을 유지하면서 활용할 수 있도록 좋은 방향으로 이끌어야 한다”라고 말했다. 통제가 되지 않는 AI를 편리성에 취해 잘못 사용하면 엄청난 위험을 초래할 수 있다는 것. 예를 들어 고해성사 내용은 절대적 비밀이 요구되지만, 해킹이나 시스템 오작동으로 유출될 수 있다. 또 데이터를 보관하는 기관, 국가 등에 의해 악용될 가능성도 배제하기 어렵다. 예를 들어 최근 개인정보 유출 우려가 불거진 중국 AI ‘딥시크’가 고해성사에 활용될 경우 어떤 악영향을 미칠지 가늠하기 어렵다.

교황청이 제안한 AI에 담아야 할 기준은 △인간 존엄성 존중 △생명 보호 △프라이버시와 데이터 윤리 △진리와 조작 방지 △AI의 결정에 대한 인간의 궁극적 책임 강조 △정의와 형평성 △노동과 공동선 등이다.

“AI에 종속된 삶이 아닌, AI를 타인 및 세상과의 관계를 증진하는 방향으로 사용하기 위해서는 알고리즘에 의해서가 아니라 자신의 의지로 얼마나 다양한 정보를 얻고 있는지, 컴퓨터, 스마트폰 등 AI 기술의 방해를 받지 않고 얼마나 시간을 보낼 수 있는지 등에 대해 늘 질문을 던져야 합니다.”

이 주교는 “편리성에 취해 인간이 스스로 사고하고 선택하는 능력을 AI에 의존하는 것은 결국 AI의 노예가 되는 길”이라고 말했다.

© dongA.com All rights reserved. 무단 전재, 재배포 및 AI학습 이용 금지

트렌드뉴스

-

1

“감히 노동절에 바게트를 사다니”…프랑스 흔든 ‘빵의 전쟁’

-

2

“현주엽에게 학폭 당해” 인터넷에 올린 누리꾼 ‘무죄’ 확정

-

3

이것이 ‘맨손 악수’…하정우, ‘손털기’ 논란 뒤 사진 왕창 올려

-

4

코요태 신지-가수 문원 오늘 결혼…축가 백지영, 사회는 문세윤

-

5

삼전 노조에 뿔난 LG 노조 “비겁하고 경솔한 책임 전가…사과하라”

-

6

“여러분 때문에 국힘 안돼” “장동혁!”…박형준 개소식서 고성-항의

-

7

임형주 150억 저택 공사비 미지급 논란…업체들 “3년째 못 받아”

-

8

또 제주 렌터카…만취 30대男, 중앙선 넘어 돌진해 7명 중경상

-

9

“3개월 통보했는데 왜 못 나가?”…전세 해지 뒤 막히는 ‘보증금’ [집과법]

-

10

2년 전 징후도 잡아냈다…AI, 췌장암 진단 정확도 ‘전문의 3배’

-

1

‘추다르크’ 추미애 vs ‘고졸신화’ 양향자…경기지사 ‘女대女’ 대결

-

2

美, 주독미군 5000명 철수 명령…나토 보복 현실화

-

3

삼바 노조 “영업익 20% 성과급” 전면파업… SK 하청도 배분 요구

-

4

삼전 노조에 뿔난 LG 노조 “비겁하고 경솔한 책임 전가…사과하라”

-

5

“여러분 때문에 국힘 안돼” “장동혁!”…박형준 개소식서 고성-항의

-

6

‘尹 어게인’ 재등판한 국힘… 대구달성 이진숙 - 하남갑 이용 공천

-

7

‘한동훈과 단일화 할거냐’ 국힘 면접질문에…韓 “나하고만 싸우려 해”

-

8

시속 153km 과속하다 중앙선 넘어 승객 숨지게 한 택시기사 ‘집유’

-

9

한동훈 “국힘 당권파, 부산 북갑서 민주당 아닌 한동훈과 싸우려 해”

-

10

국힘 “李, 특검법에 꿀 먹은 벙어리…당사자가 단 한마디 안 해”

트렌드뉴스

-

1

“감히 노동절에 바게트를 사다니”…프랑스 흔든 ‘빵의 전쟁’

-

2

“현주엽에게 학폭 당해” 인터넷에 올린 누리꾼 ‘무죄’ 확정

-

3

이것이 ‘맨손 악수’…하정우, ‘손털기’ 논란 뒤 사진 왕창 올려

-

4

코요태 신지-가수 문원 오늘 결혼…축가 백지영, 사회는 문세윤

-

5

삼전 노조에 뿔난 LG 노조 “비겁하고 경솔한 책임 전가…사과하라”

-

6

“여러분 때문에 국힘 안돼” “장동혁!”…박형준 개소식서 고성-항의

-

7

임형주 150억 저택 공사비 미지급 논란…업체들 “3년째 못 받아”

-

8

또 제주 렌터카…만취 30대男, 중앙선 넘어 돌진해 7명 중경상

-

9

“3개월 통보했는데 왜 못 나가?”…전세 해지 뒤 막히는 ‘보증금’ [집과법]

-

10

2년 전 징후도 잡아냈다…AI, 췌장암 진단 정확도 ‘전문의 3배’

-

1

‘추다르크’ 추미애 vs ‘고졸신화’ 양향자…경기지사 ‘女대女’ 대결

-

2

美, 주독미군 5000명 철수 명령…나토 보복 현실화

-

3

삼바 노조 “영업익 20% 성과급” 전면파업… SK 하청도 배분 요구

-

4

삼전 노조에 뿔난 LG 노조 “비겁하고 경솔한 책임 전가…사과하라”

-

5

“여러분 때문에 국힘 안돼” “장동혁!”…박형준 개소식서 고성-항의

-

6

‘尹 어게인’ 재등판한 국힘… 대구달성 이진숙 - 하남갑 이용 공천

-

7

‘한동훈과 단일화 할거냐’ 국힘 면접질문에…韓 “나하고만 싸우려 해”

-

8

시속 153km 과속하다 중앙선 넘어 승객 숨지게 한 택시기사 ‘집유’

-

9

한동훈 “국힘 당권파, 부산 북갑서 민주당 아닌 한동훈과 싸우려 해”

-

10

국힘 “李, 특검법에 꿀 먹은 벙어리…당사자가 단 한마디 안 해”

-

- 좋아요

- 0개

-

- 슬퍼요

- 0개

-

- 화나요

- 0개

댓글 0