잘 쓰면 득, 잘못 쓰면 독… AI 윤리기준-한계 함께 가르쳐주세요

- 동아일보

공유하기

글자크기 설정

초등생 올바른 AI 활용법

개정 교육과정 ‘디지털 소양’ 포함… 인간에 도움 주지만 의존은 금물

알고리즘 오류 땐 오답 내놓거나 인종차별 등 편향적 발언 하기도

무분별한 수용 대신 근거 따지고, 개인정보 입력 땐 필수적 정보만

경기 김포시에서 초3 아들을 키우는 학부모 이모 씨는 인공지능(AI) 채팅 프로그램 ‘챗GPT’ 등장 이후로 고민이 많아졌다. 이 씨가 가입된 온라인 커뮤니티에서는 챗GPT를 활용하면 학원비를 아낄 수도 있고, 자녀에게 효과적으로 영어, 코딩 등 공부를 시킬 수 있다는 글이 인기를 끌었다. 이 씨는 “아이에게 무작정 쓰지 말라고 할 수도 없고, 어떻게 쓰라고 해야 할지도 잘 모르겠다”며 한숨을 쉬었다.

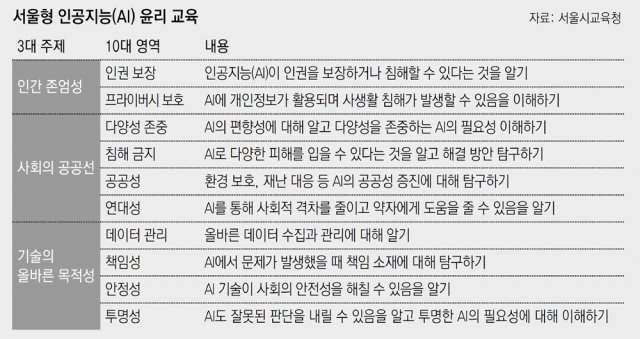

챗GPT의 등장 이후로 교육 현장에서도 AI 활용에 대한 논의가 활발해지고 있다. AI 활용 방법에 대한 교육과 더불어 AI를 더 잘 쓰기 위한 윤리 교육도 함께 이뤄져야 한다는 지적이 나온다. 서울시교육청이 발간한 ‘서울형 인공지능 윤리교육 자료’와 ‘교원을 위한 인공지능 첫걸음’ 책자를 기반으로 초등생을 대상으로 ‘AI를 올바르게 활용하는 법’에 대해 정리해 봤다.

● 디지털 시대에 AI는 핵심 소양

2020년 12월 과기정통부에서 발표한 AI 윤리기준은 최고 가치를 ‘인간성’으로 제시하고, 이를 가진 AI를 개발하고 활용하는 과정에서 △인간의 존엄성 △사회의 공공선 △기술의 합목적성을 지키도록 했다.

● ‘양날의 검’ AI

학생들이 AI를 활용할 때에는 ‘양날의 검’이라는 것을 기억하는 게 좋다. AI는 그 자체만으로 사람들에게 도움을 줄 수도 있지만, 인권을 침해할 수 있는 도구이기도 하다. AI의 발달로 수화 번역 애플리케이션이 등장해 청각장애인이 아닌 사람들도 청각장애인의 언어를 이해하고 소통할 수 있게 되는 등 인권 신장에도 도움이 되고 있다.

반면 AI가 주는 정보를 인간이 부문별하게 받아들이면서 적절하지 못한 언어를 배우거나, AI에 과도하게 의존하게 되는 경우도 생겨났다. 과제를 할 때 챗GPT가 내놓는 답을 그대로 학교에 제출하거나, AI가 준 내용에 따라 스스로 생각해 보지 않고 행동하는 경우도 적지 않다.

AI는 다양한 사람들을 존중하는 방향으로 활용해야 한다. AI는 사용자가 어느 한쪽으로 치우친 정보를 입력하면 편향성을 가지게 된다. 그 과정에서 특정 집단이나 개인이 피해를 입을 수도 있다. 2016년 미국 마이크로소프트(MS)사가 개발한 AI 채팅봇 ‘테이’는 일부 극우 성향 사용자들을 통해 인종·성차별적 표현을 학습한 뒤 부적절한 발언을 해 16시간 만에 운영이 중단됐다.

● AI의 한계 아는 것도 중요

AI도 잘못된 판단을 내릴 수 있다는 것을 알고, 이를 검증하려는 노력도 함께 해야 한다. AI는 빅데이터와 알고리즘을 바탕으로 인간이 알기 힘든 것을 파악하고, 이를 바탕으로 미래를 예측하거나 상황을 분석한다. 그 과정이 복잡하기에 때때로 사람들은 손쉽게 AI의 답이 정답이라고 간주하기도 한다. 그러나 AI도 정보가 잘못됐거나 알고리즘이 틀렸다면 오답을 내놓기 때문에 근거를 제시하라고 하는 등 검증이 필요하다.

AI가 문제를 일으켰을 때 책임이 누구에게 있느냐를 두고 갈등이 발생할 수도 있어 미리 책임 소재를 생각해 보는 것도 필요하다. 일례로 자율주행 자동차가 자율주행 시스템의 오류로 사고를 낸다면 개발 및 판매사, 사용자, 보험사 사이에서 책임을 두고 공방이 벌어질 것이다. 하지만 모두 각각의 책임이 있다는 점을 알고 피해를 막기 위해 함께 노력하는 게 중요하다.

© dongA.com All rights reserved. 무단 전재, 재배포 및 AI학습 이용 금지

트렌드뉴스

-

1

홍해 틀어쥔 후티 참전, 韓 ‘유럽 수출길’ 비상

-

2

“트럼프 배 불리는 전쟁” “학교폭격 살인” 美 사상 최대 반전시위

-

3

“이물질 나왔다” 짜장면 21개 환불 요구한 손님…알고 보니

-

4

이란 공격에 4500억짜리 美 ‘하늘의 눈’ E-3 파괴

-

5

[김승련 칼럼]국민의힘, 짠물의 힘 vs 맹물의 힘

-

6

장수 1위 일본의 비밀…밥이 아니라 ‘이것이었다

-

7

8번중 5번 보수가 차지했던 경기지사, 후보조차 못찾는 국힘

-

8

[횡설수설/장택동]세탁실·화장실 고장으로 철수한 20조 원짜리 항모

-

9

[오늘의 운세/3월 30일]

-

10

법정서 ‘강도’ 대면하는 나나 “뭔가 많이 잘못됐다”

-

1

李 “국가폭력 범죄자들 훈·포장 박탈은 당연한 조치”

-

2

李 “국가폭력, 공소시효 폐지…나치 전범처럼 영구 책임”

-

3

이정현 “가장 어려운 곳에서 역할”…전남·광주 통합시장 출마 시사

-

4

‘공천 내홍’ 국민의힘, 경기지사 유승민 출마 설득 총력전

-

5

조국, ‘출퇴근 대중교통 한시 무료화’ 제안…“이번 추경에 넣어야”

-

6

법정서 ‘강도’ 대면하는 나나 “뭔가 많이 잘못됐다”

-

7

이란, 호르무즈에 ‘150조 톨게이트’ 만드나…통행료 부과법 추진

-

8

정청래 ‘노무현 정신’ 언급하며 “김부겸, 대구서 꼭 이기고 돌아오라”

-

9

“손에 피 묻혔다”…전쟁이 불붙인 역대 최대 美 ‘노 킹스’ 시위

-

10

“이물질 나왔다” 짜장면 21개 환불 요구한 손님…알고 보니

트렌드뉴스

-

1

홍해 틀어쥔 후티 참전, 韓 ‘유럽 수출길’ 비상

-

2

“트럼프 배 불리는 전쟁” “학교폭격 살인” 美 사상 최대 반전시위

-

3

“이물질 나왔다” 짜장면 21개 환불 요구한 손님…알고 보니

-

4

이란 공격에 4500억짜리 美 ‘하늘의 눈’ E-3 파괴

-

5

[김승련 칼럼]국민의힘, 짠물의 힘 vs 맹물의 힘

-

6

장수 1위 일본의 비밀…밥이 아니라 ‘이것이었다

-

7

8번중 5번 보수가 차지했던 경기지사, 후보조차 못찾는 국힘

-

8

[횡설수설/장택동]세탁실·화장실 고장으로 철수한 20조 원짜리 항모

-

9

[오늘의 운세/3월 30일]

-

10

법정서 ‘강도’ 대면하는 나나 “뭔가 많이 잘못됐다”

-

1

李 “국가폭력 범죄자들 훈·포장 박탈은 당연한 조치”

-

2

李 “국가폭력, 공소시효 폐지…나치 전범처럼 영구 책임”

-

3

이정현 “가장 어려운 곳에서 역할”…전남·광주 통합시장 출마 시사

-

4

‘공천 내홍’ 국민의힘, 경기지사 유승민 출마 설득 총력전

-

5

조국, ‘출퇴근 대중교통 한시 무료화’ 제안…“이번 추경에 넣어야”

-

6

법정서 ‘강도’ 대면하는 나나 “뭔가 많이 잘못됐다”

-

7

이란, 호르무즈에 ‘150조 톨게이트’ 만드나…통행료 부과법 추진

-

8

정청래 ‘노무현 정신’ 언급하며 “김부겸, 대구서 꼭 이기고 돌아오라”

-

9

“손에 피 묻혔다”…전쟁이 불붙인 역대 최대 美 ‘노 킹스’ 시위

-

10

“이물질 나왔다” 짜장면 21개 환불 요구한 손님…알고 보니

-

- 좋아요

- 0개

-

- 슬퍼요

- 0개

-

- 화나요

- 0개

![[사설]시도지사 출마 의원, 유불리 계산 말고 5월 전 사퇴가 옳다](https://dimg.donga.com/a/464/260/95/1/wps/NEWS/FEED/Donga_Home_News2/133633282.1.thumb.jpg)

댓글 0