AI, 3시간분량 앵커 목소리 학습시키자, “다누리호 화성 탐사” 허위 리포트 생성

- 동아일보

공유하기

글자크기 설정

[위기-기회 갈림길에 선 AI] <1> 민주주의 위협 비상등

AI 악용 허위정보 손쉽게 만들어

韓-美 등 내년 선거 앞두고 비상

“목적지는 화성입니다. 탐사선 이름은 국민 공모로 정해진 다누리. 화성을 마음껏 누리고 오라는 뜻이죠.”지난달 31일 서울 동작구 숭실대 형남공학관에서 익숙한 목소리의 뉴스 리포트가 흘러나왔다. 목소리의 주인공은 유명 방송사의 메인뉴스 앵커 A 씨. A 앵커는 “화성을 우리 손으로 탐사하다니 꿈같은 일”이라며 뉴스 리포트를 이어갔다.

언뜻 들으면 실제 뉴스 같은 이 리포트는 사실 앵커의 목소리를 정수환 숭실대 전자정보공학부 교수 연구팀이 인공지능(AI) 기술로 편집한 허위 조작 정보다. 지난해 8월 발사된 한국의 달 탐사선 다누리의 목적지를 화성으로 바꾼 것이다.

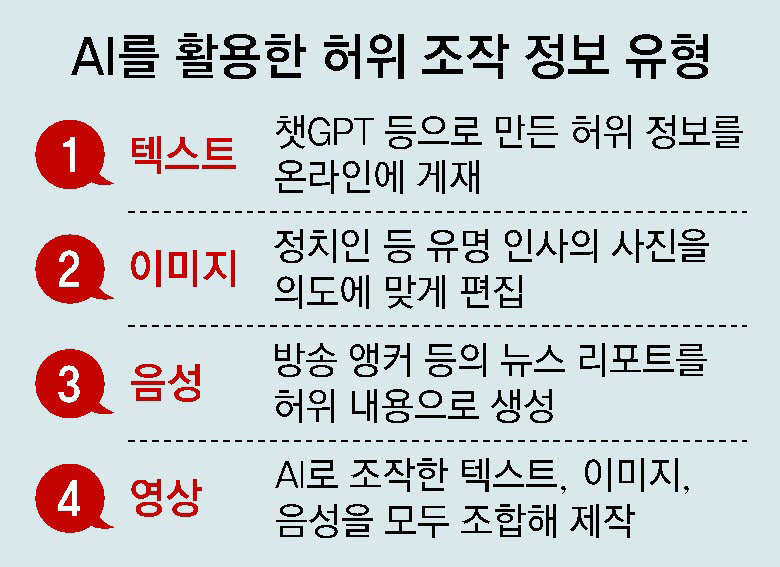

AI 서비스 상용화로 음성과 이미지, 영상을 조작해 허위 정보를 만들어 배포하는 게 쉬워지며 온라인 소통과 토론을 기반으로 한 민주주의가 위협 받는다는 우려도 나온다. AI 탐지 업체인 미국 딥미디어는 올해 전 세계적으로 50만 개의 조작된 음성과 영상이 공유될 것으로 전망했다.

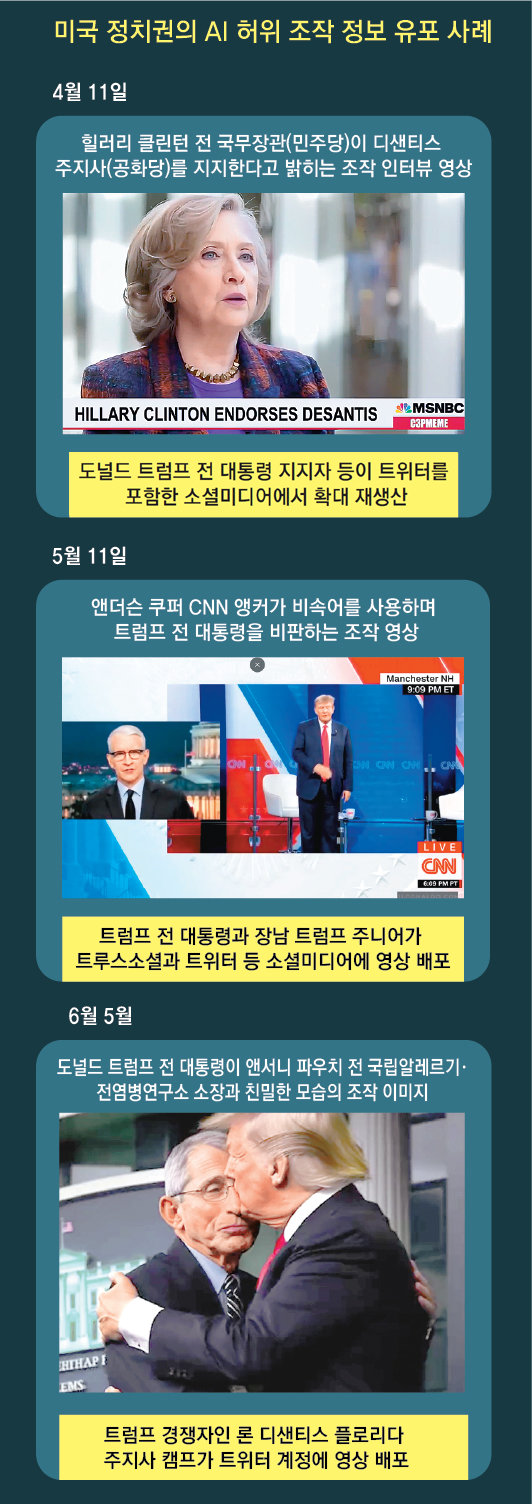

내년 11월 대선을 앞둔 미국 정치권은 이미 허위 정보들로 홍역을 치르고 있다. 공화당 대선 주자인 론 디샌티스 플로리다 주지사 캠프가 경쟁자인 도널드 트럼프 전 대통령을 비판하는 영상을 트위터에 올리며 AI 기술로 조작한 사진을 포함시켰다. 22대 국회의원 선거를 10개월 앞둔 한국 역시 위험에서 자유롭지 않다. 하지만 이를 제도적으로 규제하고 기술적으로 검증하기 위한 논의는 아직 초기 단계에 머물러 있다. 지난달 16일(현지 시간) 미 의회의 AI 청문회에서 샘 올트먼 오픈AI 최고경영자(CEO)와 상원의원들은 “선거에 악영향을 미칠 수 있는 기술에 대한 규제가 필요하다”고 주장했다.

“100% 가짜” 美대선 허위뉴스에 잡음 넣고 판독하자 “100% 진짜”

생성형 AI 기술 빠르게 발전… “합성 여부 100% 검증 불가능”

대선 앞둔 美정치권도 혼란 가중

트럼프 “CNN앵커, 날 비판” 영상

CNN 확인 결과 ‘AI 조작 영상’

대선 앞둔 美정치권도 혼란 가중

트럼프 “CNN앵커, 날 비판” 영상

CNN 확인 결과 ‘AI 조작 영상’

‘1분.’

지난해 8월 공개된 ‘다누리’ 탐사선 관련 뉴스 리포트 영상의 배경 이미지를 ‘달’에서 ‘화성’으로 바꾸는 데 걸린 시간이다. 방법은 간단했다. 국내 기업의 이미지 생성형 인공지능(AI) 서비스에 접속해 뉴스 캡처 이미지를 올리고 뉴스 화면의 달 배경을 까맣게 덧칠한 뒤 ‘Mars’를 입력했다. 그러자 AI는 뉴스 캡처 화면에 화성 표면으로 보이는 이미지를 생성해 채워 넣었다. 여기에 AI가 조작한 앵커의 음성을 입히면 한국이 달을 넘어 화성 궤도까지 갈 수 있는 탐사선 발사에 성공했다는 그럴듯한 허위 정보가 만들어진다. 포토샵 등 전문적인 편집 프로그램은 전혀 사용하지 않았다.

● “생성형 AI 기술 악용한 허위 정보 폭증 우려”

AI로 만들어지는 허위 정보에 대한 우려와 논란이 확산하고 있는 가장 큰 이유는 기술 발전에 따라 숙련되지 않은 일반 이용자들도 고품질의 조작 콘텐츠를 쉽게 제작할 수 있게 됐기 때문이다. 오픈AI의 ‘달리(DALL·E)2’나 스타트업 ‘미드저니’ 등의 생성형 AI 서비스를 쓰면 간단한 명령어 입력만으로 이미지의 배경이나 자막을 쉽게 바꿀 수 있다. 이용자가 유명인의 얼굴을 딥페이크 방식으로 자신에게 덧씌워 실시간으로 영상을 스트리밍할 수 있는 기술도 이미 공개돼 있다.

아예 AI를 이용해 만든 허위 정보들로 채워진 웹사이트도 우후죽순 만들어지고 있다. 미국 비영리단체 뉴스가드에 따르면 8일 허위 정보 유통 웹사이트는 150개 이상 운영되고 있다. 뉴스가드의 지난달 초 첫 조사(49개) 때보다 3배 이상 수준으로 늘어난 수치다. 스티븐 브릴 뉴스가드 공동 최고경영자(CEO)는 “AI를 활용하면 사이트 제작 비용이 훨씬 저렴해지고 더 많이 (허위 정보를) 생산할 수 있다”고 지적했다.

● “대책 논의에도 100% 검증은 불가능”

지난해 20대 대선 당시 여야 후보는 AI 기술을 유세에 사용하며 선거운동을 펼치기도 했다. 하지만 이제는 각 정치 진영이나 지지층이 이를 악용할 수 있다는 우려가 나온다. 허위 정보를 만드는 건 쉬워졌지만 이를 판별하기는 갈수록 어려워지고 있기 때문이다. 정수환 숭실대 전자정보공학부 교수 연구팀을 통해 미국 대선 관련 허위 정보에 약간의 잡음을 추가한 뒤 현장에서 음성 합성 판독 프로그램을 사용하자 ‘진짜 확률 100%’라는 결과가 나왔다. 잡음을 추가하기 전 ‘허위 확률 100%’라고 나왔던 결과가 뒤집힌 것이다. AI 합성 여부는 억양이나 숨소리 등을 통해 확인하는데 잡음이 이를 교란했기 때문이다. 연구팀이 잡음을 추가하는 데 걸린 시간은 5초에 불과했다.

AI 합성 영상도 마찬가지다. 과거 AI 합성 영상은 일반 이용자가 봐도 인물이 고개를 끄덕이거나 돌릴 때 눈코입 배치가 어색한 사례가 많았지만 이제는 일반 이용자가 금방 분별하기 어려운 수준에 올라섰다.

이 같은 우려를 잠재우기 위해 미국과 유럽연합(EU)은 규제 입법에 앞서 AI를 악용하는 행위 등을 규제하기 위한 공동 행동강령 마련에 착수했다. 행동강령의 내용은 아직 공개되지 않았지만 학계와 업계에선 AI 생성 콘텐츠를 표시하는 워터마킹(불법복제 방지 무늬) 의무화 방안과 외부 감사 의무화 등이 거론된다. 하지만 AI로 워터마크를 삭제하는 기술이 동시에 만들어지고 있어 효과가 제한적일 것이란 지적이 나온다. 미국 텍사스주 상원은 2019년 공직 후보자를 비방하거나 선거에 영향을 주기 위한 딥페이크 영상의 제작과 배포를 금지하는 법안을 처음으로 도입하기도 했다.

정 교수는 “(선거 국면에서) AI로 만든 허위 정보가 온라인에서 퍼져 유권자들에게 알려지는 것은 순식간이며 돌이킬 수 없다”며 “(모든 사회 구성원이) AI 기술이 민주주의 가치를 근본적으로 위협할 수도 있는 기술이라는 점을 인지해야 한다”고 말했다.

© dongA.com All rights reserved. 무단 전재, 재배포 및 AI학습 이용 금지

트렌드뉴스

-

1

술취한 15세女, 4명이 성폭행…“동의했다” 남성 말 믿은 경찰

-

2

[김순덕 칼럼]황당 X에 잡힌 李, 대통령 주변이 단단히 고장났다

-

3

K팝 뮤비 나온 ‘졸리 딸’, 가명 쓰며 댄스 실력으로 오디션 합격

-

4

李 “조폭 연루설 유포로 대선 훔쳐…국힘 사과 기다린다”

-

5

3570억원짜리 美 무인정찰기 ‘트리톤’ 추락…이란 “격추했다”

-

6

트럼프 “中, 이란에 무기 안 보내기로…호르무즈 개방 기뻐해”

-

7

핸들 놓고 손 머리에…‘크루즈’ 맹신한 고속도로 운전자 아찔

-

8

국힘 ‘장동혁 패싱’ 가시화…TK·서울·부산 ‘독자 선대위’ 꿈틀

-

9

겁에 질린 여성 옆에서 ‘히죽’…이스라엘 점령지 사진 파장

-

10

문채원 6월 결혼 “신랑은 비연예인”…자필 편지 인사

-

1

“후보는 피눈물 나는데, 장동혁 美서 화보찍나”…국힘 의원들 “억장 무너져”

-

2

李 “조폭설 아니었으면 ‘0.73%차 대선’ 달라져…국힘 사과 않나”

-

3

李 “형사처벌 남발돼… 웬만한 사람 다 전과”

-

4

신현송 한은총재 후보, 英국적 딸 ‘내국인’으로 강남 ‘불법 전입신고’

-

5

[이진영 칼럼]일개 검사 하나 못 잡아 안달인가

-

6

실향민 2세 스틸 “부모님은 공산주의서 탈출… 난 보수주의자”

-

7

배현진 “장동혁, 선거 포기했으면 사퇴든 2선 후퇴든 결단해달라”

-

8

박형준 “지지율差 10%P면 해볼만… 보수 세력 하나로 뭉쳐야”

-

9

“트럼프 미친 척하나, 정말 미쳤나”…‘정신이상설’ 다시 불붙어

-

10

與김상욱 “울산시장 단일화 진보당 제안 환영…조국당도 동참을”

트렌드뉴스

-

1

술취한 15세女, 4명이 성폭행…“동의했다” 남성 말 믿은 경찰

-

2

[김순덕 칼럼]황당 X에 잡힌 李, 대통령 주변이 단단히 고장났다

-

3

K팝 뮤비 나온 ‘졸리 딸’, 가명 쓰며 댄스 실력으로 오디션 합격

-

4

李 “조폭 연루설 유포로 대선 훔쳐…국힘 사과 기다린다”

-

5

3570억원짜리 美 무인정찰기 ‘트리톤’ 추락…이란 “격추했다”

-

6

트럼프 “中, 이란에 무기 안 보내기로…호르무즈 개방 기뻐해”

-

7

핸들 놓고 손 머리에…‘크루즈’ 맹신한 고속도로 운전자 아찔

-

8

국힘 ‘장동혁 패싱’ 가시화…TK·서울·부산 ‘독자 선대위’ 꿈틀

-

9

겁에 질린 여성 옆에서 ‘히죽’…이스라엘 점령지 사진 파장

-

10

문채원 6월 결혼 “신랑은 비연예인”…자필 편지 인사

-

1

“후보는 피눈물 나는데, 장동혁 美서 화보찍나”…국힘 의원들 “억장 무너져”

-

2

李 “조폭설 아니었으면 ‘0.73%차 대선’ 달라져…국힘 사과 않나”

-

3

李 “형사처벌 남발돼… 웬만한 사람 다 전과”

-

4

신현송 한은총재 후보, 英국적 딸 ‘내국인’으로 강남 ‘불법 전입신고’

-

5

[이진영 칼럼]일개 검사 하나 못 잡아 안달인가

-

6

실향민 2세 스틸 “부모님은 공산주의서 탈출… 난 보수주의자”

-

7

배현진 “장동혁, 선거 포기했으면 사퇴든 2선 후퇴든 결단해달라”

-

8

박형준 “지지율差 10%P면 해볼만… 보수 세력 하나로 뭉쳐야”

-

9

“트럼프 미친 척하나, 정말 미쳤나”…‘정신이상설’ 다시 불붙어

-

10

與김상욱 “울산시장 단일화 진보당 제안 환영…조국당도 동참을”

-

- 좋아요

- 0개

-

- 슬퍼요

- 0개

-

- 화나요

- 0개

댓글 0